IT war gestern, jetzt kommt die Ära der KI-Agenten, so der Tenor der Keynote, mit der CEO Jensen Huang die Nvidia-Konferenz GTC 2026 in San Jose eröffnete. Die „AI Factory“ soll den agentischen Heerscharen den Weg ebnen. An diesen KI-Fabriken arbeitet Nvidia zusammen mit zahlreichen Partnern – in rasantem Tempo und auf globalem Maßstab.

„Willkommen, bienvenue, welcome, im Cabaret au Cabaret, to Cabaret!“ Mit diesen Worten begrüßt der Conférencier in Bob Fosses Oscar-prämiertem Musikfilm „Cabaret“ die Besucher der Berliner Kabarettbühne Kit Kat Klub zu Zeiten der Weimarer Republik. Als Conférencier könnte auch Jensen Huang jederzeit Karriere machen, falls das mit der KI eines Tages mal nicht mehr so gut laufen sollte: Kein Konzernlenker scheint sich im Rampenlicht so wohlzufühlen wie der Nvidia-Gründer und -CEO, stets mit schwarzer Lederjacke über der stolzgeschwellten Brust.

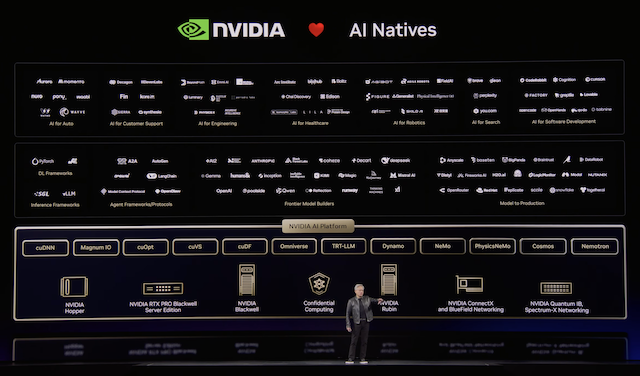

Huang hat durchaus Grund, stolz auf sein Unternehmen zu sein. In seiner Ansprache zeichnete er Nvidias Aufstieg zum Leitstern am KI-Firmament nach. Heute unterhält Nvidia Partnerschaften mit allem, was in der IT Rang, Namen und/oder Potenzial hat: mit den großen Unternehmens-IT-Ausrüstern ebenso wie mit den Hyperscalern, unzähligen KI-Spezialisten und „KI-nativen“ Startups sowie natürlich mit den Chipschmieden Samsung und TSMC.

Fluchtpunkt der gemeinsamen Arbeit ist in Huangs Vision die AI Factory, natürlich auf Basis von Nvidia-Technik. „Das ist eure Token-Fabrik“, predigte der KI-Prophet, „das ist eure KI-Fabrik, das ist euer künftiger Umsatz.“

Partner und Kooperationen

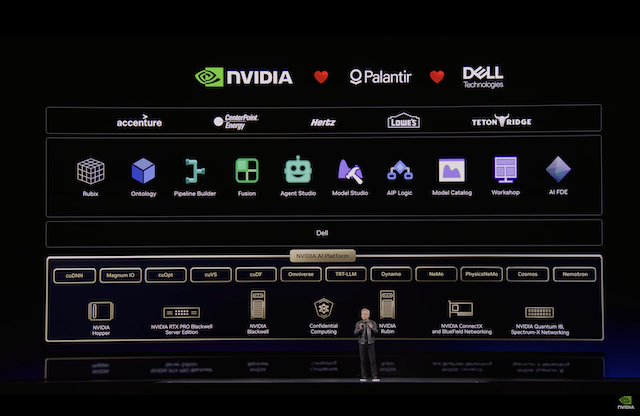

Auf der Keynote-Bühne hob er die Kooperationen mit IBM und Dell hervor. Gemeinsam mit IBM habe man die Lieferkettenprozesse des Lebensmittelkonzerns Nestlé KI-beschleunigt. Die zusammen mit Dell entwickelte „Dell AI Data Platform with Nvidia“ soll den KI-Datenlebenszyklus automatisieren und so ebenfalls Prozesse befeuern. Mit diesem Partner habe man zudem für den Überwachungskonzern Palantir eine KI-Plattform designt, die sich isoliert (Air-Gapped) überall auf der Welt betreiben lasse – neugierige staatsnahe Dienste wird’s freuen.

Allerlei IT-Größen stellten zur GTC Salven von KI-Neuheiten vor. Bei Dell reichte das Spektrum vom Desktop mit Nvidias GB300 Grace Blackwell Ultra Desktop Superchip über einen flüssigkeitsgekühlten Switch mit 1,6 Tb/s bis zur Unterstützung von Nvidias Quantencomputing-Techniken NVQLink und Cuda-Q.

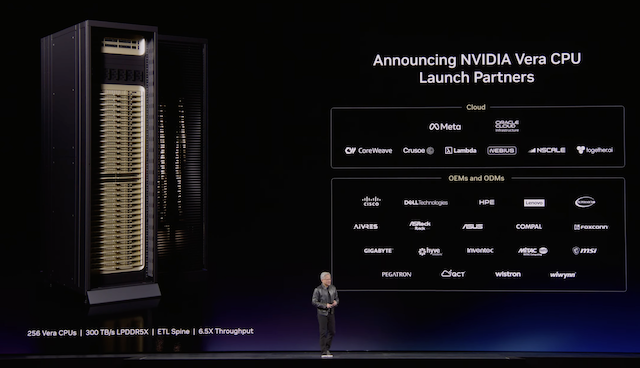

Dell konkurriert im KI-Segment vor allem mit HPE, zumal dieser Wettbewerber seit der Cray-Akquisition 2019 über Supercomputing-Kompetenz verfügt und deshalb hohe KI-Skalierbarkeit betont. So meldete HPE – wie Dell ein Launch-Partner von Nvidias neuen Vera-CPUs – unter anderem, man liefere mit Cray Supercomputing GX240 bis zu 640 CPUs pro System, mit dem HPE XD700 bis zu 128 Rubin-GPUs. Für Organisationen mit hohen Anforderungen an Datensouveränität gibt es nun HPE Private Cloud AI in einer großen abgeschotteten (Air-Gapped) Konfiguration für den Konzern- oder Behördeneinsatz.

NetApp wiederum stellte zur GTC die AI Data Engine (AIDE) vor, einen sicheren, einheitlichen KI-Datenplattform-Stack, natürlich im Zusammenspiel mit dem Gastgeber entwickelt und ins Referenzdesign der Nvidia AI Data Platform integriert. Und Cisco betonte, man ermögliche sichere KI-Fabriken vom Rechenzentrum bis zum Edge. Der neue Switch N9100, so der Netzwerkausrüster, bewältige dank Nvidias Spectrum-6 Ethernet-Chips 102,4 Tb/s.

Die Liste der Partnermeldungen, die zur GTC erschienen, ließe sich beliebig fortsetzen. Huang scherzte in der Keynote, man habe die zahlreichen Logos der KI-Partner auf der Riesenleinwand bewusst so klein gehalten, dass das Publikum sie nicht lesen kann. So könne niemand beleidigt sein, wenn sein Logo fehlt.

Supercomputer für KI

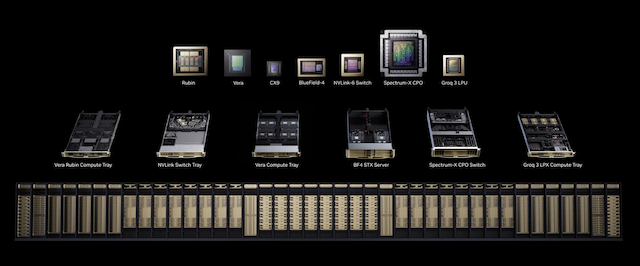

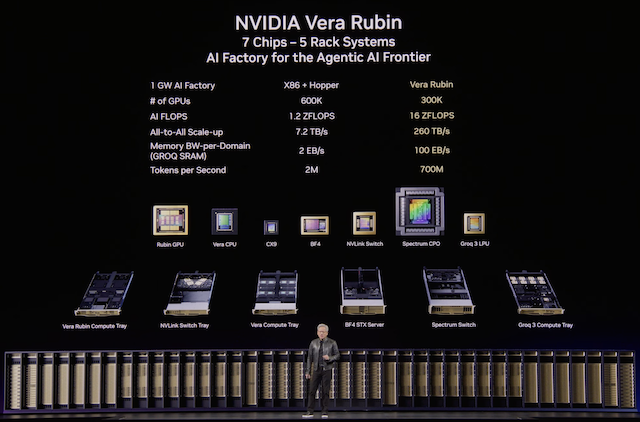

Trotz der vielen netten Worte über die vielen Partner und die vielen gemeinsamen Kunden: Im Mittelpunkt von Huangs Ausführungen stand Nvidias hauseigene KI-Architektur und damit die neue Vera-Rubin-Plattform. Mit ihr will Nvidia eine komplette KI-Fabrik aus einer Hand bieten. Sie ruht auf sechs Säulen: Vera Rubin NVL72 GPU Racks, Vera CPU Racks (dank Agentic AI gewinnen neben den KI-typischen GPUs nun auch die guten alten CPUs wieder an Bedeutung, wenn auch in KI-optimierter Form), BlueField-4 STX für die Datenspeicherung, NVLink 72 für den Interconnect der Systeme, die erwähnten Spectrum-6 SPX Ethernet-Racks zur Vernetzung mit externen Ressourcen sowie Groq 3 LPX als Inferenzbeschleuniger.

In der Summe, so Huang, ergebe dies einen „Supercomputer für KI“. Damit könne Nvidia der einzige Anbieter weltweit den gesamten KI-Lebenszyklus abbilden: vom Modell-Pre-Training über Post-Training, Anpassung und Skalierung bis zur Inferenz – und das für alle KI-Modelle und Einsatzszenarien.

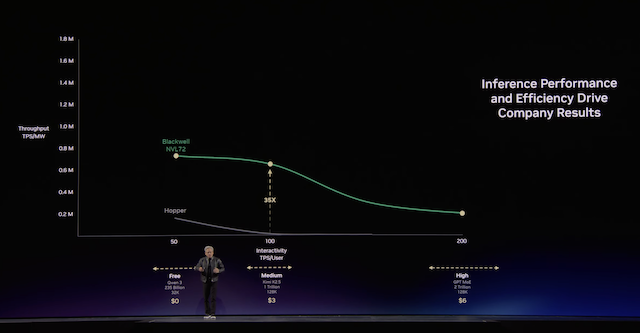

Die Vera Rubin NVL72 Plattform bietet laut Nvidia-Angaben 3,6 ExaFLOPS Rechenleistung bei 260 TBytes/s NVLink-Bandbreite. Im Segment der Premium-Services entspreche dies einem Leistungssprung bei der KI-Performance pro Watt um den Faktor 35 – was, wie Huang betonte, in der Intel-Welt gemäß Moore’s Law unmöglich gewesen wäre.

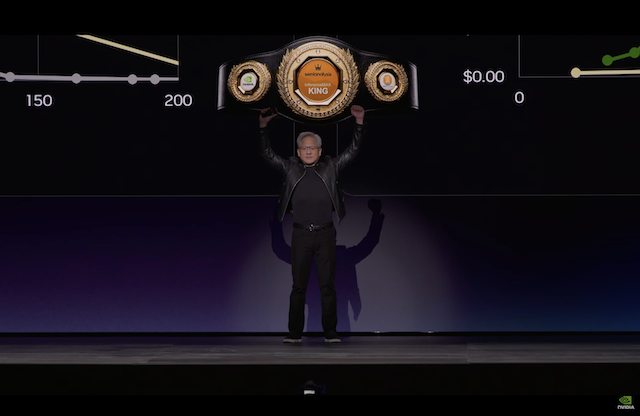

Der Nvidia-Chef warnte: „Wenn man die falsche Architektur hat, ist sie, selbst wenn sie kostenlos ist, nicht billig genug.“ Denn man müsse für KI trotzdem ein Gigawatt-Rechenzentrum bauen. Das koste Unsummen, also sollte man besser sicherstellen, die beste Token-Ausbeute zu erzielen. Die hauseigene KI-Plattform sei dabei „im Moment praktisch unschlagbar“, Nvidia der „Token King“.

Der König der Agenten

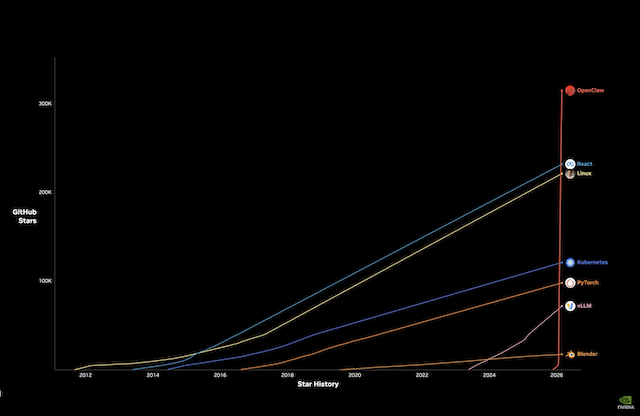

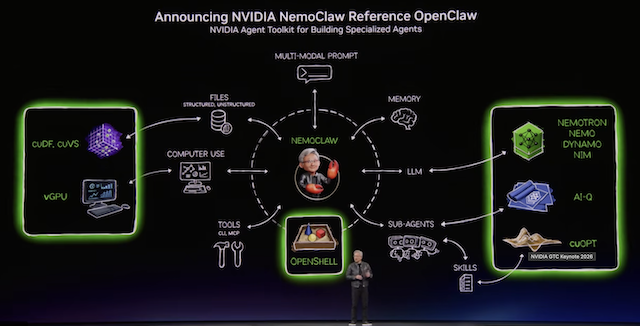

Der „King“ auf Agentenseite ist hingegen das einstige Hobbyprojekt des Österreichers Peter Steingruber: OpenClaw. Der lokal lauffähige autonome KI-Agent kann sich mit jedem großen Sprachmodell (LLM) verbinden und vielfältigste Aufgaben ausführen. Seine Akzeptanz ist seit der Veröffentlichung im November durch die Decke geschossen.

Deshalb ist Nvidia auf die OpenClaw-Rakete aufgesprungen und bietet nun mit NemoClaw ein Referenzdesign für eine unternehmensgerechte Variante an. Das Design umfasst Netzwerk-Sicherheitsbarrieren (Guardrails) und Datenschutz-Mechanismen, um die sichere Ausführung von Claws (OpenClaw-Agentenfunktionen) im Unternehmen zu ermöglichen. Dabei könne man Sprachmodelle nach Wahl nutzen.

Trotz Berichten über die Tücken und Macken unsicherer oder übereifriger KI-Agenten: Laut Huang kann man die Bedeutung des OpenClaw-Launchs als „ChatGPT-Moment“ der agentischen KI gar nicht überschätzen. Windows habe den Personal Computer allen zugänglich gemacht, OpenClaw liefere nun den persönlichen KI-Agenten für alle. „Jedes Unternehmen auf der Welt muss heute eine OpenClaw-Strategie haben“, betonte er. „Das ist der neue Computer.“

Der Mensch in der KI-Fabrik

Wenn das Rechenzentrum zur KI-Fabrik mutiert und der Computer zum autonomen KI-Agenten, welche Rolle bleibt dann für den Menschen in der schönen neuen Arbeitswelt? Wird der Nutzer die Füße hochlegen, sich ein buntes Getränk mit Schirmchen greifen und seinen persönlichen Agenten anweisen: „NemoClaw, entwickle eine App, auf die die Welt bisher vergeblich gewartet hat, erstelle ein Marketing-Konzept, lanciere die App in allen App-Stores und stelle den Umsatzreport als Balkengrafik dar“? Oder wird sein Chef ziemlich bald feststellen, dass er dank mächtiger KI-Agenten gar keine KI-Fabrikarbeiter mehr braucht, und unseren Nutzer samt buntem Getränk und Schirmchen auf die Straße setzen?

Die KI-Branche erklärt solche Sorgen gerne für unbegründet: Wie schon die vorherigen industriellen Revolutionen (Dampfmaschine, Elektrizität, Internet), so werde auch diese neue Basistechnologie zwar Jobs automatisieren. Aber zugleich werde KI die Produktivität dramatisch steigern und damit zahllose neue Stellen schaffen.

KI-Revolution im Kontext

Auf den ersten Blick leuchtet das ein, jedoch: Die KI-Revolution findet in einem völlig anderen globalen Kontext statt als die vorherigen Umwälzungen. Denn inzwischen hat der Mensch sieben jener neun planetaren Grenzen überschritten, die den dauerhaften Fortbestand unseres Habitats sichern – Stichworte: Klimawandel, Artensterben, Übersäuerung der Meere etc. Die Kosten des Fortschritts lassen sich somit nicht mehr in althergebrachter Weise einfach externalisieren, sprich: nonchalant der Umwelt vor die Füße kippen. Dennoch bauen IT-Betreiber, allen voran die Hyperscaler, derzeit KI-Rechenzentren, als gäbe es kein Morgen – oft mit eigener Stromversorgung, weil man gar nicht weiß, wo man genug Energie für die stromhungrigen KI-Fabriken bekommen soll.

„Der größte Infrastrukturausbau der Geschichte ist in vollem Gange“, sagte Huang – und meinte das durchaus positiv, erfolgt doch dieser Ausbau in seiner Vision mit üppigem Einsatz von Nvidia-Technik: Er berichtete von Aussicht auf Umsatz in Höhe von einer Billion Dollar. Denn Nvidia könne jedem Unternehmen und jedem Land – auf Wunsch souveräne – KI-Fabriken liefern.

Durch Fortschritte im Chipdesign sowie Wasserkühlung, so Huang, halbiere Nvidia den Energieverbrauch. Doch zugleich verkündete er: „Wir können in unserer Lieferkette monatlich KI-Systeme mit einer Leistung von mehreren Gigawatt herstellen.“ Diese Multi-Gigawatt-KI-Leistung kommt, wie energieeffizient sie auch sein mag, zusätzlich auf den Weltmarkt. Und heizt den Planeten weiter auf. Dem Planeten kann’s wurscht sein – uns Menschen hingegen nicht.

Eigentlich wären KI-Fabriken mächtige Werkzeuge, um Mittel und Wege zur Mitigation des Klimawandels zu finden. Doch die Erfahrung lehrt: Das Gros der Einsatzfälle dürfte schlicht auf mehr Profit abzielen.

Ein Beispiel: Die KI-Fabrik eines Fast-Fashion-Unternehmen wird helfen, noch schneller noch mehr Einwegmode zu produzieren, die den Geschmack noch größerer Käuferschichten noch besser trifft. Influencer*innen werden ihre persönlichen KI-Agenten anweisen, im Web nach noch schickerer Billigmode zu stöbern, weil man für dieses eine geplante Instagram-Foto unbedingt noch das passende Outfit braucht. Ihre Follower*innen werden die Kleidung agentenbeschleunigt kaufen, bevor diese wenig später auf Altkleiderhalden in der chilenischen Atacama-Wüste landet. Ein Extrembeispiel, aber wohl leider doch ein Quentchen plausibler, als aus Bequemlichkeit anzunehmen, KI werde die Welt retten.

Was die Welt antreibt

„Money makes the world go around“, singen Liza Minelli und Conférencier Joel Grey im Kit Kat Klub des Films „Cabaret“, während das „Babylon Berlin“ auf den Nationalsozialismus zutaumelt. Ein Conférencier Jensen Huang würde heute wohl eher im KI Claw Club „AI makes the world go around“ intonieren. Doch ist es schwer, sich des Verdachts zu erwehren, dass weiterhin vor allem Geldgier die treibende Kraft menschlichen Tuns bildet – somit nicht künstliche Intelligenz und erst recht nicht menschliche Vernunft. Deshalb mag eine Steigerung der KI-Effizienz um den Faktor 35 nach einem riesigen Fortschritt aussehen. Es ist aber nicht automatisch einer.

Der talentierte Alleinunterhalter Jensen Huang gab bei seiner mehr als zweistündigen One-Man-Show auf der GTC 2026 sein Bestes, um Goldgräberstimmung für das Agentic-AI-Zeitalter zu erzeugen. In der Tat dürfte dieser Goldrausch wohl weiter Fahrt aufnehmen, tendieren doch Goldräusche wie auch industrielle Revolutionen dazu, enorme Eigendynamik zu entwickeln, planetare Grenzen hin oder her.

In der Konsequenz heißt das: Klimaschutz war gestern, jetzt kommt die Ära der KI-Agenten. Uns Menschen bleibt dann nur die Rolle agentenbeschleunigt rotierener Rädchen im Gewinngetriebe der globalen KI-Fabrik. In diesem Sinne, liebe künftige KI-Fabrikarbeiter-Belegschaft:

Willkommen, bienvenue, welcome,

im Cabaret, au Cabaret, to the AI-generated Cabaret!

Hat euch dieser Text gefallen? Dann erzählt doch einem Menschen davon, den das Thema ebenfalls interessieren könnte! Denn liebevoll erstellte Inhalte verbreiten sich am besten per Mundpropaganda. Bildquelle sämtlicher Bilder: Nvidia GTC 2026 Keynote Video-Stream

Du muss angemeldet sein, um einen Kommentar zu veröffentlichen.